Google Search Console nâng cao: Phân tích Crawl Stats & User Agent chi tiết

Trong thế giới của SEO, việc theo dõi và tối ưu hóa khả năng crawl của trang web của bạn là một yếu tố cực kỳ quan trọng. Google Search Console (GSC) cung cấp cho chúng ta nhiều công cụ để theo dõi hiệu suất này, trong đó crawl stats GSC là một trong những chỉ số quan trọng nhất. Hiểu rõ về cách phân tích và tối ưu hóa dữ liệu crawl không chỉ giúp cải thiện thứ hạng tìm kiếm mà còn giúp tăng trải nghiệm người dùng. Hãy cùng tìm hiểu chi tiết về cách sử dụng các tính năng này trong bài viết này.

Công cụ Crawl Stats: Khám phá sức mạnh của dữ liệu

Crawl stats trong Google Search Console là một công cụ mạnh mẽ để theo dõi cách Googlebot crawl trang web của bạn. Dữ liệu này cung cấp thông tin chi tiết về tần suất và số lượng trang được crawl, giúp bạn đánh giá hiệu suất crawl tổng thể.

Tại sao cần phân tích crawl stats?

- Hiểu rõ về tần suất và số lượng trang được crawl.

- Phát hiện vấn đề với khả năng crawl của trang web.

- Đảm bảo rằng Googlebot có thể truy cập vào tất cả nội dung mới và quan trọng.

Làm thế nào để truy cập crawl stats?

Bạn có thể truy cập vào phần Crawl > Crawl Stats trong Google Search Console. Tại đây, bạn sẽ thấy biểu đồ thể hiện số lượng trang được crawl hàng ngày hoặc hàng tuần. Điều này giúp bạn theo dõi xu hướng và phát hiện bất kỳ vấn đề nào có thể ảnh hưởng đến khả năng crawl của trang web.

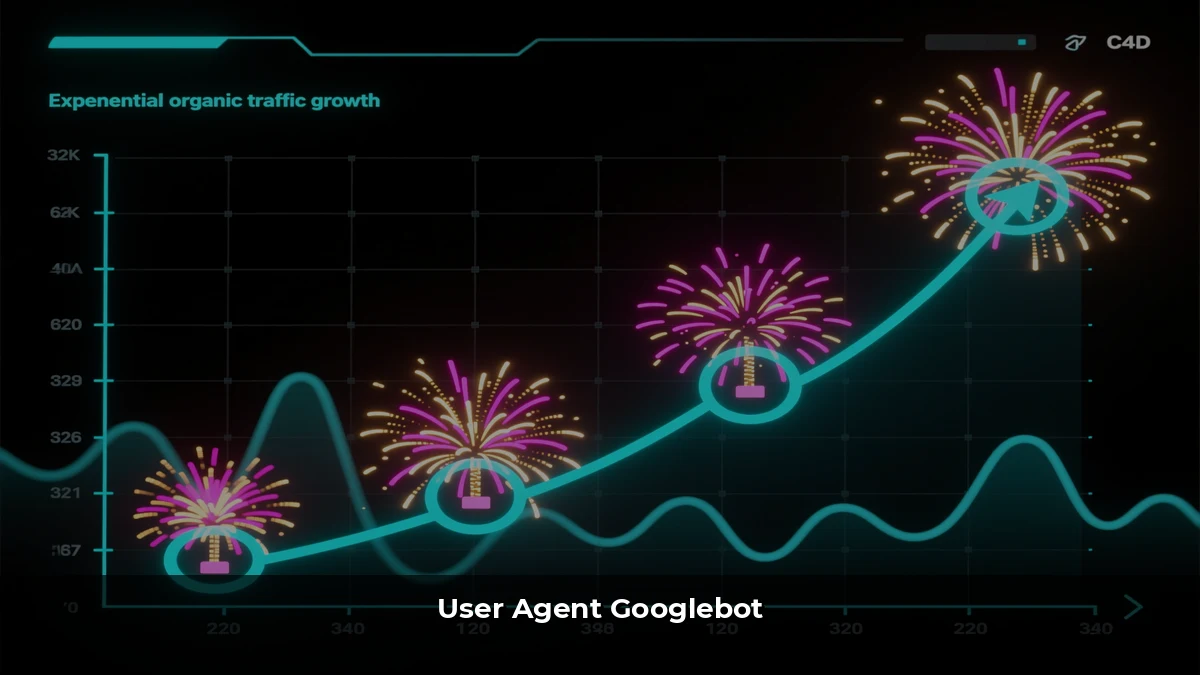

User Agent trong Google Search Console: Hiểu rõ hơn về Googlebot

Googlebot là user agent mà Google sử dụng để crawl và index trang web của bạn. Hiểu rõ về user agent và cách nó tương tác với trang web của bạn là rất quan trọng để tối ưu hóa khả năng crawl. Thông qua Google Search Console, bạn có thể kiểm tra xem Googlebot đã crawl trang web của mình như thế nào.

Phân biệt giữa các user agent

Google sử dụng nhiều loại user agent khác nhau để crawl trang web, bao gồm Googlebot, Googlebot-Image, và Googlebot-Mobile. Mỗi user agent có chức năng riêng biệt và hiểu rõ chúng sẽ giúp bạn tối ưu hóa trải nghiệm người dùng trên các thiết bị và định dạng khác nhau.

Cách kiểm tra user agent trong Google Search Console

Bạn có thể kiểm tra user agent trong phần Coverage > URL Inspection của Google Search Console. Tại đây, bạn có thể nhập URL cụ thể và xem thông tin chi tiết về cách Googlebot crawl trang đó, bao gồm user agent đã được sử dụng.

Tối ưu hóa crawl hiệu quả: Các bước thực hiện

Hiểu rõ về crawl stats và user agent chỉ là bước đầu tiên. Để tối ưu hóa khả năng crawl của trang web, bạn cần thực hiện một số bước cụ thể để đảm bảo rằng Googlebot có thể truy cập vào tất cả nội dung mới và quan trọng.

Xây dựng sitemap và submit lên Google Search Console

Một sitemap đầy đủ và cập nhật thường xuyên sẽ giúp Googlebot tìm thấy tất cả nội dung quan trọng trên trang web của bạn. Đảm bảo rằng bạn đã xây dựng và submit sitemap lên Google Search Console.

Thực hiện kiểm tra và khắc phục lỗi crawl

Sử dụng phần Crawl > Errors trong Google Search Console để kiểm tra và khắc phục bất kỳ lỗi crawl nào có thể ảnh hưởng đến khả năng crawl của trang web. Đây là một bước quan trọng để đảm bảo rằng Googlebot có thể truy cập vào tất cả nội dung mới và quan trọng.

Kết nối với các công cụ SEO khác

Google Search Console là một công cụ mạnh mẽ nhưng nó cũng hoạt động tốt khi kết hợp với các công cụ SEO khác. Dưới đây là một số ví dụ về cách bạn có thể kết nối Google Search Console với các công cụ SEO khác để tối ưu hóa hiệu suất tổng thể:

Optimize your WooCommerce site for multi-vendor environments

Nếu bạn đang vận hành một trang web bán hàng đa nhà cung cấp trên WooCommerce, hãy tham khảo bài viết WooCommerce SEO cho site đa nhà cung cấp: Xử lý vấn đề với Google Search Console.

Tối ưu hóa Twitter/X cho thương hiệu của bạn

Bài viết Tối ưu Twitter/X SEO cho thương hiệu: Hashtag strategy cung cấp hướng dẫn chi tiết về cách sử dụng hashtag hiệu quả để tăng cường khả năng hiển thị của thương hiệu trên mạng xã hội.

Zalo SEO cho trường học

Nếu bạn đang quản lý một trường học và muốn tối ưu hóa thông báo tuyển sinh trên Zalo, hãy tham khảo bài viết Zalo SEO cho trường học: Tối ưu thông báo tuyển sinh.

Tối ưu hóa SEO đa ngôn ngữ trên WordPress

Đối với trang web đa ngôn ngữ, bài viết Tối ưu SEO đa ngôn ngữ WordPress: So sánh WPML, Polylang sẽ giúp bạn hiểu rõ hơn về cách sử dụng các plugin như WPML và Polylang để tối ưu hóa SEO đa ngôn ngữ.

Cách đi link diễn đàn hiệu quả

Nếu bạn muốn tận dụng các diễn đàn để xây dựng liên kết chất lượng, bài viết Cách đi link diễn đàn (Forum) hiệu quả không bị spam sẽ cung cấp cho bạn hướng dẫn chi tiết về cách làm điều đó.

Với những thông tin trên, hy vọng bạn đã có cái nhìn tổng quan về cách sử dụng Google Search Console để tối ưu hóa khả năng crawl của trang web. Hãy nhớ rằng, việc theo dõi và tối ưu hóa khả năng crawl là một quá trình liên tục và cần được thực hiện thường xuyên để đảm bảo rằng trang web của bạn luôn đạt được hiệu suất tốt nhất.

Phân Tích User Agent trong Google Search Console

User Agent là một thành phần quan trọng trong quá trình crawl của Googlebot. Mỗi User Agent có chức năng riêng và giúp Google hiểu rõ hơn về cách trang web của bạn được crawl và index.

- Googlebot: Crawl nội dung chính của trang web.

- Googlebot-Image: Crawl hình ảnh.

- Googlebot-News: Crawl nội dung tin tức.

- Googlebot-Mobile: Crawl trang web dành cho thiết bị di động.

Bạn có thể theo dõi hoạt động của từng User Agent qua phần Crawl > Crawl Stats trong GSC. Điều này giúp bạn nắm bắt được Googlebot đang tập trung vào đâu và có cần điều chỉnh gì không.

Tối Ưu Hóa Cấu Hình Crawl

Cấu hình crawl đúng đắn sẽ giúp Googlebot hiểu rõ hơn về cấu trúc trang web của bạn, từ đó tăng hiệu suất crawl và cải thiện khả năng index. Dưới đây là một số gợi ý:

- Sitemap: Cung cấp Sitemap đầy đủ và cập nhật thường xuyên để Googlebot dễ dàng tìm thấy các trang mới hoặc đã thay đổi.

- Robots.txt: Tối ưu hóa file robots.txt để chỉ định chính xác những phần nào của website cần crawl và những phần nào cần bỏ qua.

- Thời gian crawl: Sử dụng công cụ Throttle trong GSC để kiểm soát tốc độ crawl của Googlebot, tránh làm chậm website.

Các Vấn Đề Thường Gặp Khi Crawl

Khi phân tích Crawl Stats, bạn có thể gặp một số vấn đề phổ biến như lỗi 404, lỗi 500, hay trang bị chặn bởi robots.txt. Dưới đây là cách xử lý:

- Lỗi 404: Kiểm tra và sửa lỗi URL bị hỏng hoặc không tồn tại.

- Lỗi 500: Đảm bảo server chạy ổn định và không có vấn đề về code.

- Trang bị chặn: Kiểm tra lại file robots.txt để đảm bảo không có trang quan trọng bị chặn.

Cách Sử Dụng Crawl Errors Hiệu Quả

Crawl Errors trong GSC là một nguồn thông tin quý giá để phát hiện và khắc phục các vấn đề kỹ thuật trên trang web. Dưới đây là cách sử dụng chúng:

- Xem xét các lỗi: Phân loại và xem xét từng lỗi để xác định nguyên nhân.

- Sửa lỗi: Áp dụng các giải pháp phù hợp để khắc phục lỗi.

- Theo dõi tiến trình: Theo dõi tình trạng của các lỗi đã được khắc phục.

Tối Ưu Hóa Cho Thiết Bị Di Động

Trong thời đại di động, việc tối ưu hóa cho thiết bị di động trở nên vô cùng quan trọng. Dưới đây là một số gợi ý:

- Responsive Design: Thiết kế website tương thích với nhiều kích thước màn hình.

- Mobile-First Indexing: Google ưu tiên index phiên bản di động trước. Hãy chắc chắn rằng phiên bản di động của bạn hoạt động tốt.

- Test Speed: Sử dụng công cụ kiểm tra tốc độ load trang trên mobile như PageSpeed Insights để tối ưu hóa tốc độ tải trang.

Câu Hỏi Thường Gặp

Hỏi: Làm sao để biết Googlebot đã crawl trang web của mình?

Trả lời: Bạn có thể kiểm tra trong phần Crawl > Crawl Stats trong Google Search Console để xem thống kê về hoạt động crawl.

Hỏi: Tại sao cần tối ưu hóa file robots.txt?

Trả lời: File robots.txt giúp Googlebot biết được những phần nào của website cần crawl và những phần nào cần bỏ qua, từ đó tối ưu hóa quá trình crawl.

Hỏi: Lỗi 404 có ảnh hưởng đến SEO không?

Trả lời: Lỗi 404 có thể ảnh hưởng đến trải nghiệm người dùng và SEO nếu không được xử lý kịp thời. Hãy kiểm tra và sửa lỗi URL để tránh tình trạng này.

Kết Luận

Qua bài viết này, bạn đã hiểu rõ hơn về cách phân tích Crawl Stats và User Agent trong Google Search Console. Việc theo dõi và tối ưu hóa quá trình crawl sẽ giúp cải thiện hiệu suất index và tăng khả năng xếp hạng trên SERP. Đừng quên sử dụng các công cụ và hướng dẫn trong GSC để tối ưu hóa cấu hình crawl và khắc phục các vấn đề kỹ thuật.

Nếu bạn cần tư vấn chiến lược SEO chuyên nghiệp, hãy liên hệ Seo Nhanh - đơn vị hàng đầu về dịch vụ SEO tổng thể tại Việt Nam.